L'avènement récent de l'intelligence artificielle générative (des algorithmes capables d'analyser des données, prendre des décisions, faire des prédictions et aussi de générer de nouvelles données) a déjà révolutionné nos vies et nos sociétés, grâce à des outils tels que Chat-GPT ou Gemini. Pour l'instant, l'IA générative est utilisée essentiellement pour générer des données multimédias (édition de texte, résumé, retouche photo, génération de vidéos, etc.). Cependant, dans un avenir proche, elle pourra aussi générer des données plus techniques, telles que celles produites expérimentalement dans les laboratoires de recherche universitaires.

Cela aura des conséquences sans précédent sur la production de connaissances scientifiques, qu'il convient d'anticiper, notamment parce que l'IA peut avoir ce que l'on appelle des hallucinations : elle génère des détails qui semblent plausibles au premier abord mais qui sont en réalité erronés ou impossibles (source inexistante, contraintes du monde réel ignorées, etc.).

Le cas de la biologie moléculaire

La complexité de la biologie moléculaire est telle que dans la masse des données correspondantes de minuscules hallucinations pourraient passer inaperçues, conduisant à des conclusions erronées (par exemple, un biomarqueur inexistant) avec des conséquences dévastatrices, telles que la corruption de la littérature scientifique ou telles que le financement d'essais cliniques sans intérêt. Cependant, interdire l'IA générative dans la recherche scientifique priverait les communautés scientifiques et médicales d'outils puissants.

Pour faire face à ce dilemme, les chercheurs du CEA-Irig ont proposé de répertorier divers cas d'utilisation où l'IA peut être utilisée en toute fiabilité grâce à une politique d'atténuation des risques adéquate. Leurs travaux présentent une dizaine de cas d'usage classés en trois catégories :

La génération de nouvelles hypothèses,

la génération de nouvelles données

l'amélioration des logiciels de biologie computationnelle.

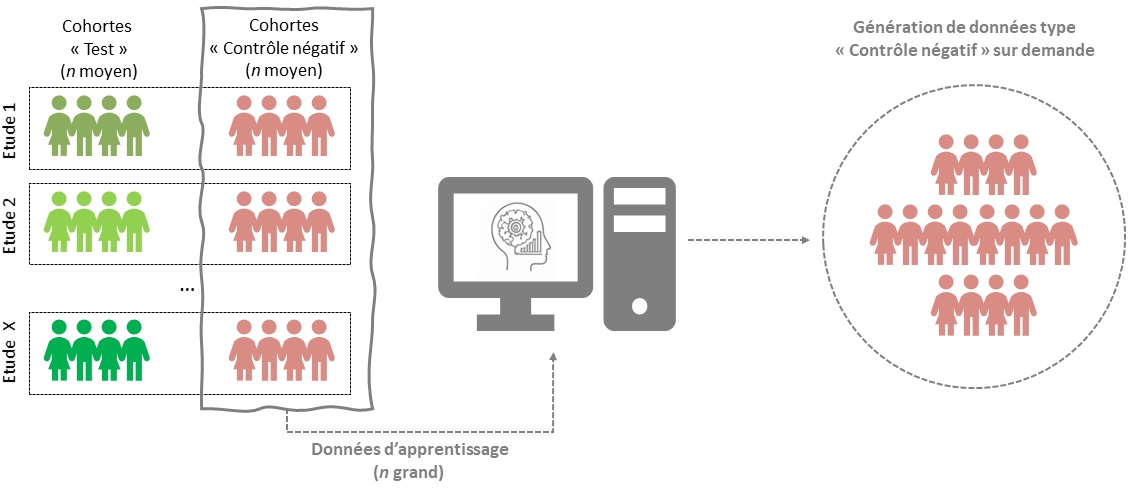

Figure : Exemple de cas d'usage

Figure : Exemple de cas d'usage

Compléter une cohorte en générant des données supplémentaires sur des patients dans le groupe de patients malades (groupe « test », en vert sur le schéma) serait très risqué, car toute hallucination non détectée conduirait à une représentation biaisée de la maladie. À l'inverse, compléter le groupe de patients sains (groupe « contrôle négatif », en rouge sur le schéma) qui sert de contrôle dans l'étude peut être conforme à une politique d'atténuation des risques : premièrement, parce que les hallucinations non détectées entraîneraient ici une plus grande diversité au sein du groupe de contrôle, ce qui est connu pour être un moyen efficace de limiter les risques de fausses découvertes. Ensuite, parce que les patients sains ont été admis plus fréquemment dans les études de cohorte, de sorte que les données potentiellement disponibles pour entraîner l'IA sont plus importantes, plus robustes et plus cohérentes.

Cet exemple illustre comment un algorithme d'IA générative donné, adapté à une tâche donnée, peut être utilisé de différentes manières, avec une exposition différente aux risques induits par les hallucinations. Bien qu'elles ne soient pas exhaustives, ces utilisations constituent une première base pour une intégration correcte de l'IA générative dans la démarche scientifique, car elles incitent les chercheurs à adopter un regard critique sur son utilisation.